Olá, Ana Paula. Como vai?

Excelente prática! Você aplicou um dos conceitos mais poderosos da Engenharia de Prompt: a Decomposição de Tarefas (ou Chain-of-Thought).

O desafio do "Enigma do Coronel Mostarda" é um teste clássico de lógica que confunde muitas IAs porque exige que elas processem negações e exclusões simultâneas. Pelas suas imagens, percebemos um comportamento muito comum no desenvolvimento de modelos de linguagem (LLMs):

O Fenômeno do Raciocínio Lógico

- A "Preguiça" Inicial do Modelo: IAs como o ChatGPT, às vezes, tentam prever a resposta mais provável estatisticamente em vez de computar a lógica passo a passo. Por isso, na primeira tentativa, ele falhou.

- O Poder do "Dividir para Conquistar": Quando você dividiu a tarefa em subtarefas (instruções mais claras), você forçou o modelo a usar mais "tokens" de processamento para cada premissa. Isso é o que chamamos de dar tempo para a IA pensar.

Por que a resposta correta é a (a)?

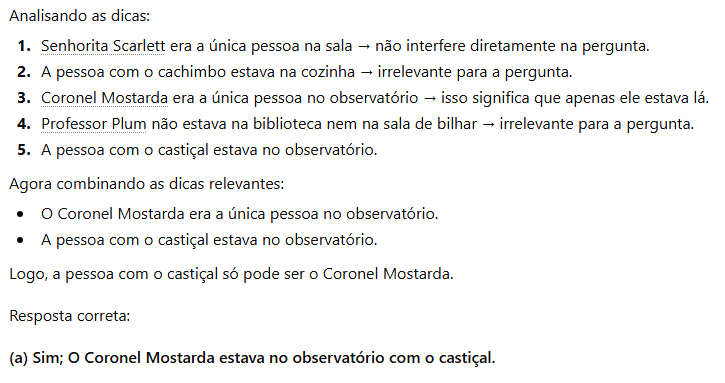

Para fixar o raciocínio que as IAs Le Chat e Gemini pegaram de primeira:

- Fato A: A instrução 3 diz que o Coronel Mostarda NÃO estava no observatório.

- Conclusão Lógica: Se ele não estava lá, qualquer afirmação que diga que ele "não foi ao observatório com [qualquer objeto]" é verdadeira por definição, pois ele sequer pisou no local.

É curioso notar como o Gemini e o Le Chat lidaram bem com a relevância. Isso mostra que diferentes modelos possuem "pesos" diferentes para interpretação de texto e lógica formal.

Dica Técnica de Engenharia de Prompt

Sempre que você tiver um problema de lógica complexo, tente adicionar a frase "Pense passo a passo" ao final do seu prompt. Isso ativa o raciocínio sequencial do modelo automaticamente, muitas vezes chegando ao resultado correto sem que você precise dividir manualmente as tarefas.

Parabéns pela análise comparativa entre as ferramentas! Esse tipo de teste é fundamental para decidirmos qual IA utilizar dependendo da complexidade do nosso projeto de negócio.

Qual das três IAs você achou que explicou o raciocínio de forma mais didática para você?