Numero de requests para usar o OpenAI, acabou usei outro email, acredito que uma solução seria usar o Gemini que não tem esse problema, já uso a um bom tempo sem me preocupar com limites de requests, vou tentar mudar o código para essar ele

Numero de requests para usar o OpenAI, acabou usei outro email, acredito que uma solução seria usar o Gemini que não tem esse problema, já uso a um bom tempo sem me preocupar com limites de requests, vou tentar mudar o código para essar ele

Oi, Rodrigo! Como vai?

Agradeço por compartilhar essa dica com a comunidade Alura.

Continue explorando essas possibilidades e testando adaptações no projeto, pois esse tipo de experimentação ajuda bastante no aprendizado.

Conte com o apoio do Fórum na sua jornada. Abraços e bons estudos!

Eu mudei o primeiro código para o Gemini - LangChain e funcionou muito bem !!!

Rodei um Bash:

pip install -U langchain-google-genai langchain>=0.3.0 python-dotenv

no .ENV eu coloquei o meu Key da Gemini:

GOOGLE_API_KEY=sua_chave_aqui

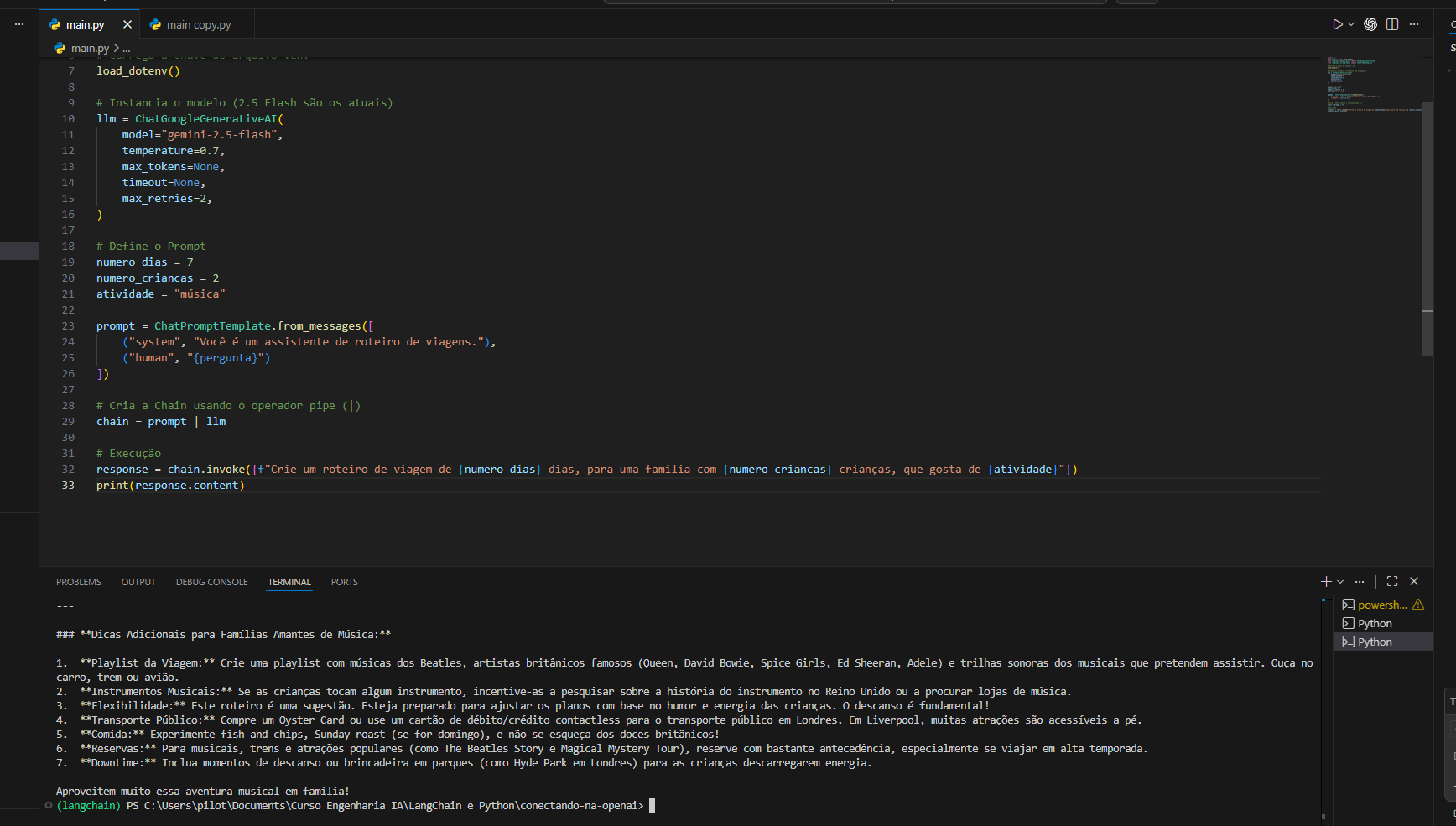

Depois alterei o código para o que está abaixo:

import os

from dotenv import load_dotenv

from langchain_google_genai import ChatGoogleGenerativeAI

from langchain_core.prompts import ChatPromptTemplate

# Carrega a chave do arquivo .env

load_dotenv()

# Instancia o modelo (2.5 Flash são os atuais)

llm = ChatGoogleGenerativeAI(

model="gemini-2.5-flash",

temperature=0.7,

max_tokens=None,

timeout=None,

max_retries=2,

)

# Define o Prompt

numero_dias = 7

numero_criancas = 2

atividade = "música"

prompt = ChatPromptTemplate.from_messages([

("system", "Você é um assistente de roteiro de viagens."),

("human", "{pergunta}")

])

# Cria a Chain usando o operador pipe (|)

chain = prompt | llm

# Execução

response = chain.invoke({f"Crie um roteiro de viagem de {numero_dias} dias, para uma familia com {numero_criancas} crianças, que gosta de {atividade}"})

print(response.content)