Pessoal, boa noite!

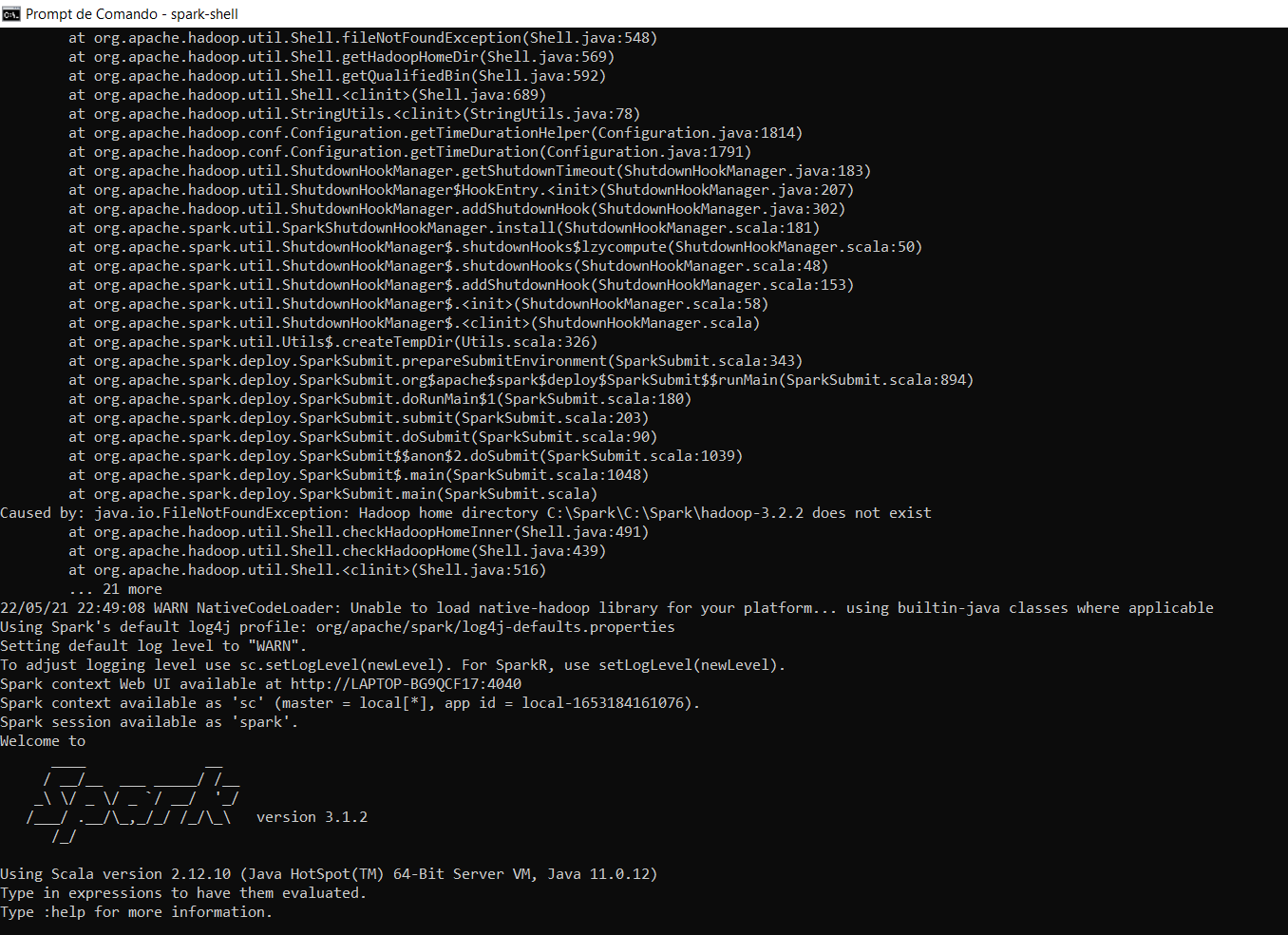

Depois de seguir os passos de instalação do Spark/hadoop, ao tentar executar o shell, deu um erro gigantesco...

Não consigo colocar todo ele aqui, mesmo assim, segue parte dele:

O que devo fazer?

C:\Users\alexa>Spark-shell.cmd

Using Spark's default log4j profile: org/apache/spark/log4j-defaults.properties

Setting default log level to "WARN".

To adjust logging level use sc.setLogLevel(newLevel). For SparkR, use setLogLevel(newLevel).

22/05/16 21:24:53 WARN NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable

22/05/16 21:24:55 ERROR SparkContext: Error initializing SparkContext.

java.lang.reflect.InvocationTargetException

at sun.reflect.NativeConstructorAccessorImpl.newInstance0(Native Method)

at sun.reflect.NativeConstructorAccessorImpl.newInstance(NativeConstructorAccessorImpl.java:62)

at sun.reflect.DelegatingConstructorAccessorImpl.newInstance(DelegatingConstructorAccessorImpl.java:45)

at java.lang.reflect.Constructor.newInstance(Constructor.java:423)

at org.apache.spark.executor.Executor.addReplClassLoaderIfNeeded(Executor.scala:909)

at org.apache.spark.executor.Executor.<init>(Executor.scala:160)

at org.apache.spark.scheduler.local.LocalEndpoint.<init>(LocalSchedulerBackend.scala:64)

at org.apache.spark.scheduler.local.LocalSchedulerBackend.start(LocalSchedulerBackend.scala:132)

at org.apache.spark.scheduler.TaskSchedulerImpl.start(TaskSchedulerImpl.scala:220)

at org.apache.spark.SparkContext.<init>(SparkContext.scala:581)

at org.apache.spark.SparkContext$.getOrCreate(SparkContext.scala:2690)

at org.apache.spark.sql.SparkSession$Builder.$anonfun$getOrCreate$2(SparkSession.scala:949)

at scala.Option.getOrElse(Option.scala:189)

at org.apache.spark.sql.SparkSession$Builder.getOrCreate(SparkSession.scala:943)

at org.apache.spark.repl.Main$.createSparkSession(Main.scala:106)

at $line3.$read$$iw$$iw.<init>(<console>:15)

at $line3.$read$$iw.<init>(<console>:42)

at $line3.$read.<init>(<console>:44)

at $line3.$read$.<init>(<console>:48)

at $line3.$read$.<clinit>(<console>)

at $line3.$eval$.$print$lzycompute(<console>:7)

at $line3.$eval$.$print(<console>:6)

at $line3.$eval.$print(<console>)

at sun.reflect.NativeMethodAccessorImpl.invoke0(Native Method)

at sun.reflect.NativeMethodAccessorImpl.invoke(NativeMethodAccessorImpl.java:62)

at sun.reflect.DelegatingMethodAccessorImpl.invoke(DelegatingMethodAccessorImpl.java:43)

at java.lang.reflect.Method.invoke(Method.java:498)

at scala.tools.nsc.interpreter.IMain$ReadEvalPrint.call(IMain.scala:747)

at scala.tools.nsc.interpreter.IMain$Request.loadAndRun(IMain.scala:1020)

at scala.tools.nsc.interpreter.IMain.$anonfun$interpret$1(IMain.scala:568)

at scala.reflect.internal.util.ScalaClassLoader.asContext(ScalaClassLoader.scala:36)

at scala.reflect.internal.util.ScalaClassLoader.asContext$(ScalaClassLoader.scala:116)

at scala.reflect.internal.util.AbstractFileClassLoader.asContext(AbstractFileClassLoader.scala:41)

at scala.tools.nsc.interpreter.IMain.loadAndRunReq$1(IMain.scala:567)

at scala.tools.nsc.interpreter.IMain.interpret(IMain.scala:594)

at scala.tools.nsc.interpreter.IMain.interpret(IMain.scala:564)

at scala.tools.nsc.interpreter.IMain.$anonfun$quietRun$1(IMain.scala:216)

at scala.tools.nsc.interpreter.IMain.beQuietDuring(IMain.scala:206)

at scala.tools.nsc.interpreter.IMain.quietRun(IMain.scala:216)

at org.apache.spark.repl.SparkILoop.$anonfun$initializeSpark$2(SparkILoop.scala:83)

at scala.collection.immutable.List.foreach(List.scala:431)

at org.apache.spark.repl.SparkILoop.$anonfun$initializeSpark$1(SparkILoop.scala:83)

at scala.runtime.java8.JFunction0$mcV$sp.apply(JFunction0$mcV$sp.java:23)

at scala.tools.nsc.interpreter.ILoop.savingReplayStack(ILoop.scala:97)

at org.apache.spark.repl.SparkILoop.initializeSpark(SparkILoop.scala:83)

at org.apache.spark.repl.SparkILoop.$anonfun$process$4(SparkILoop.scala:165)

at scala.runtime.java8.JFunction0$mcV$sp.apply(JFunction0$mcV$sp.java:23)

at scala.tools.nsc.interpreter.ILoop.$anonfun$mumly$1(ILoop.scala:166)

at scala.tools.nsc.interpreter.IMain.beQuietDuring(IMain.scala:206)

at scala.tools.nsc.interpreter.ILoop.mumly(ILoop.scala:163)

at org.apache.spark.repl.SparkILoop.loopPostInit$1(SparkILoop.scala:153)

at org.apache.spark.repl.SparkILoop.$anonfun$process$10(SparkILoop.scala:221)

at org.apache.spark.repl.SparkILoop.withSuppressedSettings$1(SparkILoop.scala:189)

...