Artigo: https://towardsdatascience.com/gradient-descent-algorithm-a-deep-dive-cf04e8115f21

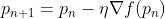

Fiquei com duvida na formula que ele usou: "Pn+1 = Pn - learningRate * o gradiente da função de Pn".

Fórmula do artigo:

Tenho algumas perguntas:

(1) - Pn+ 1 aqui é o proximo elemento de um vetor P? ou ele simplismente significa que um parametro atualizado é igual ao parametro antigo (- subtraindo) tal valor? e não tem nada a ver com indice de vetor?

(2) - Essa formula do Pn+ 1 é basicamente a mesma usada no Perceptron Simples para atualizar os pesos? Aquela formula do Perceptron simples para atualizar os pesos W: Wi = Wi - learningRate * erro * entradaXi ?

(3) - Essa formula Pn+ 1 também é a mesma usada na regressão linear com Descidade de Gradiente para atualizar os coeficientes?