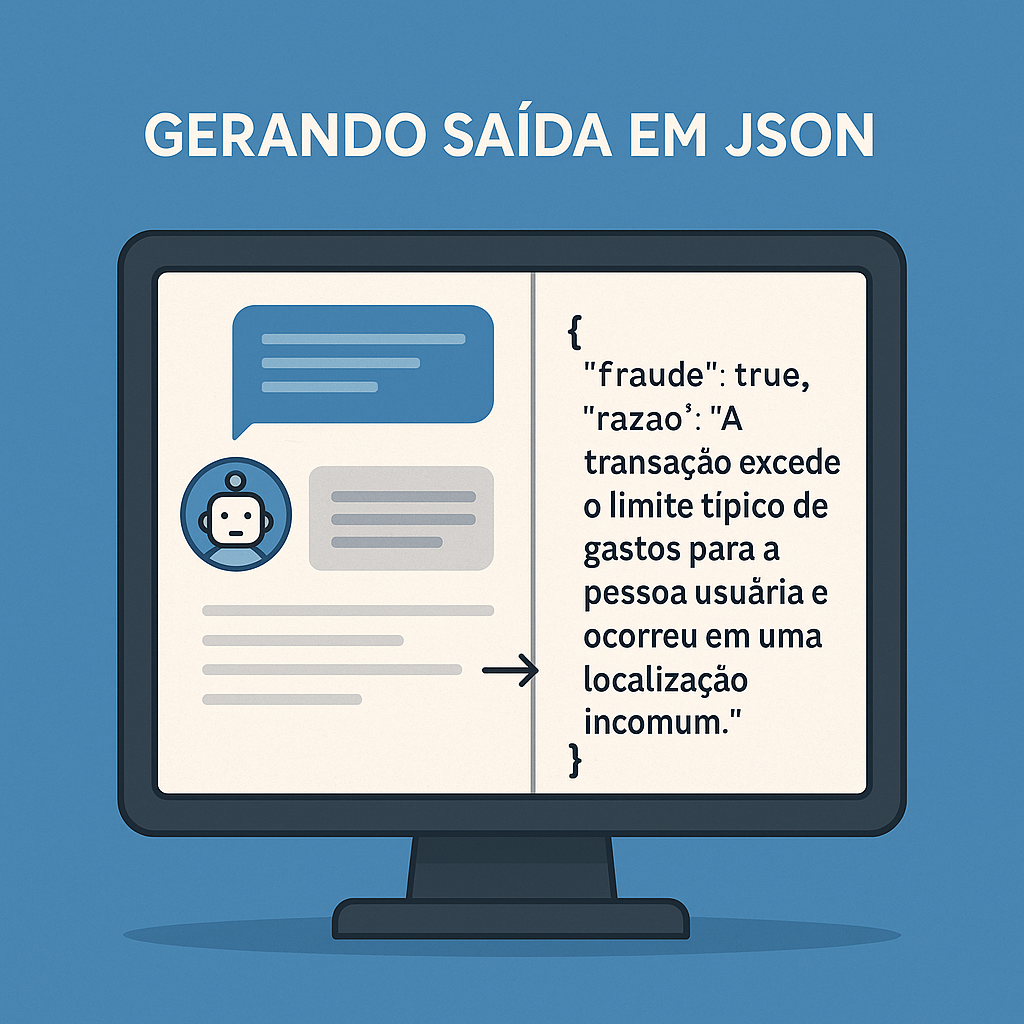

Gerando saída em JSON com Chat Completions

**Por Ricardo Costa Val do Rosario e ChatGPT 5.0 Plus

Introdução

- Uma das formas mais robustas de integrar modelos de IA a sistemas é garantir que a saída

venha em um formato estruturado.

- No contexto da API da OpenAI, isso é possível habilitando o Modo JSON, disponível

para os modelos gpt-4-turbo-preview e gpt-3.5-turbo-0125.

Sobre o Modo JSON

- O Modo JSON força o modelo a gerar apenas strings que se convertem em objetos JSON válidos.

- Garante que a resposta seja diretamente analisável por programas e pipelines de dados, sem necessidade

de parsing complexo.

Notas Importantes

1. Instrução explícita:

O termo "JSON" deve aparecer no contexto. Caso contrário, a API pode lançar erro.

2. Respostas parciais:

Se [ finish_reason for "length"], a resposta pode vir truncada. Sempre verifique esse campo.

3. Sem esquema fixo:

O modelo garante apenas validade sintática JSON, não conformidade a um schema específico.

4. Assistants API:

Até a data atual, o Modo JSON não está disponível nesse fluxo, apenas em [chat.completions.]

Exemplo em Python

from openai import OpenAI

client = OpenAI()

response = client.chat.completions.create(

model="gpt-3.5-turbo-0125",

response_format={ "type": "json_object" },

messages=[

{"role": "system", "content": "Você é um assistente útil projetado para saída em JSON."},

{"role": "user", "content": "Esta transação é fraudulenta? Detalhes da transação: Valor: R$500, Localização: São Paulo."}

]

)

print(response.choices[0].message.content)

Saída esperada

{

"fraude": true,

"razao": "A transação excede o limite típico de gastos para a pessoa usuária e ocorreu em uma localização incomum."

}

Aplicações práticas

- Esse mecanismo é extremamente útil para:

1. Sistemas antifraude (como no exemplo acima).

2. Análises médicas automatizadas (relatórios de dispositivos médicos).

3. Integração em dashboards (retornos estruturados para BI).

4. Agentes autônomos que precisam ler respostas da IA sem ambiguidade.

Conclusão

1. O Modo JSON é um recurso que aumenta a confiabilidade e previsibilidade das respostas dos modelos.

2. Ele garante que desenvolvedores possam consumir os resultados com segurança, reduzindo falhas de

parsing e aumentando a integração com sistemas críticos.

Reflexão:

Trata-se de um recurso com o potencial de se tornar poderoso na Medicina Digital, quando precisamos que a IA

retorne diagnósticos diferenciais, riscos ou alertas em formato estruturado para integração direta em prontuários

eletrônicos